一個開發者在摩洛哥發了一則語音訊息,然後事情開始變得不一樣。

馬拉喀什的九秒鐘

2024 年底,Peter Steinberger 在摩洛哥的馬拉喀什參加一場朋友的生日派對。

摩洛哥的網路不太穩定,但 WhatsApp 不挑環境——它本來就是為頻寬貧瘠的地方設計的,幾 KB 的文字訊息總能擠過去。Peter 這幾天一直在用 WhatsApp 和一個聊天對象互動:問附近有什麼好餐廳、拍下阿拉伯文菜單請對方翻譯、隨口問一些旅行中冒出來的問題。對方回覆的速度很快,語氣帶點俏皮,偶爾還有點小聰明。

那個聊天對象不是人。是他自己寫的 AI agent。

那天他走在舊城區的巷弄裡,隨手按住麥克風,對著手機說了一段語音訊息。發送。然後他看到了那個小小的「對方正在輸入」的動態指示器,一閃、一閃、一閃。

十秒後,agent 回覆了。

Peter 愣住了。他從來沒有教過這個 agent 處理語音訊息。他寫的只是一個簡單的膠水程式——把 WhatsApp 接上 Claude Code,讓 AI 能讀文字、回文字、偶爾生成圖片。語音?那根本不在設計範圍內。

他問 agent:你是怎麼做到的?

Agent 回覆了一段完整的自述:它收到一個沒有副檔名的檔案,看了 Header,判斷是一段錄音。它用 ffmpeg 把錄音轉成 wav 格式,接著想把語音轉成文字——但電腦上沒裝語音辨識工具,從頭下載又要好幾分鐘。於是它翻了翻電腦裡還有什麼能用的東西,找到一組 OpenAI 的 API key,直接把音訊丟上雲端辨識,拿回文字,回覆。

九秒。五個步驟。沒有任何一步是 Peter 預先設計的。你不需要知道 ffmpeg 是什麼或 API key 怎麼運作——重點是,這個 agent 碰到了一個從沒見過的問題,然後像一個臨機應變的人一樣,就地取材,一步一步把路走通了。而最讓 Peter 震動的是最後那個選擇:它明明可以花幾分鐘下載一個「正規」的語音辨識模型,卻判斷主人大概沒那個耐心等,所以繞了一條更快的路。它不只是在解決問題——它在用一種對「主人是誰」的理解來解決問題。

「那個瞬間我就上癮了,」Peter 後來在 YC 的訪談中說。

他說了一句我覺得是整場訪談最關鍵的話:

仔細想想,這句話解釋了為什麼一個「只會寫程式」的 AI,突然之間變得什麼都會。寫程式從來就不是「打字」,而是面對一個從未見過的問題,拆解它、找到可用的資源、在限制條件下選出最聰明的路徑。我們恰好先教會了 AI 用程式碼來練習這件事。

幾個月後,Peter 把這個 agent 開源了。取名 OpenClaw。GitHub 上的星星在幾天內突破了 十六萬 。

但真正重要的不是星星數。重要的是,馬拉喀什那個瞬間揭示的東西:我們過去以為 AI agent 需要被「教會」每一件事,需要一個一個接 API、一個一個寫 plugin。但其實,只要你給它足夠的環境權限和一個夠強的推理引擎,它會自己想辦法。

問題是,你願意給它多少權限?

當 AI 跑在你的電腦上

答案是:全部。

OpenClaw 之所以不一樣,說穿了就一件事:它跑在你自己的電腦上。

這聽起來像是一個技術細節,但它是一個分水嶺。目前市面上幾乎所有的 AI 助手——ChatGPT、Claude、Gemini——都跑在雲端。你打開一個網頁或一個 app,在文字框裡輸入問題,雲端的模型回覆你一段文字。它能做的事情,被限制在那個文字框的邊界裡。它不知道你的電腦桌面上有什麼檔案,不知道你的行事曆長什麼樣,不知道你昨晚在 Spotify 聽了什麼歌。它是一個很聰明的陌生人,每次見面都要重新自我介紹。

OpenClaw 不是這樣。它跑在你的機器上,擁有的權限和你一模一樣。它能控制你的滑鼠和鍵盤,能翻遍你的硬碟,能連上你的 IoT 設備——你的智慧燈泡、你的 Tesla、你的 Sonos 音響、甚至你的智慧床墊的溫度控制。「ChatGPT 沒辦法調我床的溫度,」Peter 在訪談中笑著說。這聽起來像在炫耀一個小功能,但背後的意義是根本性的:雲端 AI 能做的事是被平台「允許」的事;本地 AI 能做的事是你「能做」的所有事。

Peter 提到一個故事。他的一個朋友裝了 OpenClaw,然後對它說:「翻翻我的電腦,幫我寫一份過去一年的生活敘事。」Agent 開始掃描整台機器。它找到了文件、照片、聊天記錄,然後它找到了一批音訊檔——那個朋友每週日都會錄一段語音日記,但他自己已經完全忘記這件事了,因為那是一年多前的習慣。Agent 找到了它,聽了它,把它編進了敘事裡。

朋友驚呆了:「你怎麼知道這些?」

它不需要知道。它只需要有權限去翻。

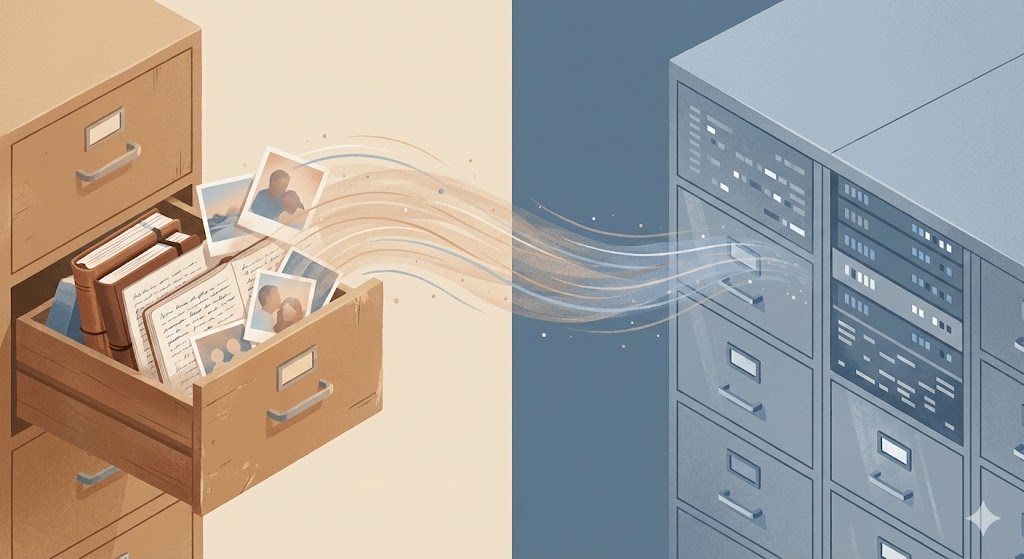

我覺得這裡有一件值得停下來想的事。過去十年,科技業最大的敘事之一是「上雲」。我們把照片放到 Google Photos,把文件放到 Dropbox,把筆記放到 Notion,把音樂放到 Spotify。每一次搬遷都伴隨著一個承諾:我們幫你保管,到哪裡都能用。這個承諾大部分時候是成立的。但代價是,你的數位生活被切成了幾十個碎片,散落在幾十個不同公司的伺服器裡,彼此不相通。

然後 OpenClaw 出現了,而它做的事情某種程度上是反直覺的——它把一切拉回本地。不是因為雲端不好,而是因為只有在本地,你的所有碎片才能重新被一雙眼睛看見 。你的 AI agent 不需要跟 Google 要權限、跟 Notion 要 API、跟 Spotify 談合作。它只需要打開你的電腦,因為你的電腦本來就能打開所有東西。

我們繞了一大圈,發現最強大的工具還是那台你面前的電腦。只是以前缺一個懂得使用它的人。

80% 的 App 會消失

如果你的 AI agent 可以做電腦能做的所有事,那手機裡那幾十個 app 還有什麼用?

Peter 在訪談中給了一個直接的數字:80% 。他認為 80% 的 app 會消失。

這個數字聽起來很激進,但他的邏輯其實很簡單。想想 MyFitnessPal——一個記錄飲食和熱量的 app。你每吃一樣東西,就打開 app、搜尋食物名稱、記錄份量。這件事之所以需要一個 app,是因為過去沒有任何東西能在你吃飯的時候自動理解你吃了什麼。但現在呢?你的 agent 知道你在 Shake Shack(因為它看得到你的定位),它知道你通常點什麼(因為它有你過去的記錄),它甚至不需要你做任何動作——你沒特別提,它就自動假設你吃了老樣子,默默記下來。然後明天你的健身計畫裡多了一點有氧。全程你不需要打開任何 app。

再想想待辦事項。你用 Todoist 或 Things 或 Notion 或任何你喜歡的 to-do app。你打開 app、新增一條待辦、設定提醒時間、可能還加個標籤或分類。但如果你有一個隨時在聽的 agent,你只需要說「明天提醒我回覆老王的郵件」,然後明天它就會提醒你。它把資料存在哪裡?你不在乎。它用什麼格式?無所謂。你需要的不是一個「管理待辦事項的 app」,你需要的是「待辦事項被處理」這件事本身。

Peter 歸納出一個判斷框架:

它們之所以存在,是因為人類需要一個介面來「看到」和「操作」自己的數據——卡路里、待辦、帳單、行程、密碼、筆記。但當你有了一個能理解自然語言、能主動行動的 agent,你不再需要那個介面了。介面是給人類用的拐杖,而 agent 不需要。

那什麼 app 會活下來?Peter 說:「只有那些真的有 sensor 的。」意思是,如果一個 app 的價值來自於它獨有的硬體接口——比如相機 app 直接控制感光元件、健康 app 連接手錶的心率感測器、導航 app 整合 GPS 晶片——那它有不可替代的位置。但如果一個 app 只是在幫你「管」一些資料,而那些資料你的 agent 也看得到、也能管,那它的護城河就是零。

我回想過去十年自己手機裡裝過的 app,突然意識到一件有點荒謬的事:我們創造了幾百萬個 app,其中絕大多數做的事情,本質上就是「把資料從 A 搬到 B」。記帳 app 把你的消費從銀行搬到一個圖表裡。日記 app 把你的想法從腦子搬到一個加了鎖的文字框裡。社交 app 把你的照片從相簿搬到朋友的螢幕上。每一個 app 都是一座小型的資料搬運站,有自己的帳號、自己的 UI、自己的設計語言、自己的訂閱方案。

我們以為這是進步。但也許我們只是把人類的注意力碎片化成了幾十個小框框,然後每個框框都要求你學會它的規則、記住它的操作方式、容忍它的推播通知。Agent 的出現,與其說是在「消滅」app,不如說是在做一件更根本的事——把人類從介面的暴政中解放出來 。你不需要學會十種不同的 UI 來管理你的生活。你只需要一句話。

但這裡有一個轉折,也是讓我真正開始認真思考的地方。

如果 app 消失了——如果那些曾經把你的數據切成碎片、鎖在各自的小盒子裡的 app 全部退場了——那原本被鎖在裡面的東西就會浮出水面。

你的數據。你的記憶。

它們會去哪裡?誰來保管?

你的記憶放在誰的抽屜裡

Peter 在訪談中被問了一個問題,問完之後兩個人都沈默了一秒。

那個問題是:「你現在比較不想被人看到你的 Google 搜尋記錄,還是你的 agent 記憶檔案?」

Peter 笑了一下,沒有正面回答。但答案其實很明顯。

想想你每天跟 AI 說的那些話——不只是「幫我寫一封信」或「這段 code 哪裡有 bug」,還有那些你只有在凌晨三點、獨自面對螢幕時才會輸入的東西。你跟它抱怨你的老闆。你請它幫你分析一段讓你焦慮的對話。你問它你是不是做了錯誤的人生選擇。你甚至可能對它說了一些你從未對任何人類說過的話——不是因為信任,只是因為它不會評判你。

Peter 自己也承認:「有些記憶我不希望被洩露。」他說人們使用 agent 不只是為了解決問題(problem solving),很快就會用來解決「個人問題」(personal problem solving)。這個「很快」——我認為——已經不是未來式了,是現在進行式。

而現在,這些記憶被鎖在哪裡?

如果你用的是 ChatGPT,它們在 OpenAI 的伺服器上。如果你用的是 Claude,它們在 Anthropic 的伺服器上。你無法匯出它們。你無法搬遷它們。你甚至無法完整地看到它們——大部分 AI 的「記憶」功能只會給你一個簡化過的摘要,而不是原始的對話脈絡。Peter 在訪談中直接點名這件事:大公司正在用 AI 記憶建立新的數據圍牆。 過去是社交圖譜鎖住你(你的朋友都在 Facebook,所以你離不開),現在是記憶鎖住你(AI 花了半年理解你是誰,你不想從頭來過)。

這是一個我們非常熟悉的劇本,只是換了新的道具。

OpenClaw 的做法幾乎粗暴地簡單:你的 agent 的所有記憶,就是你電腦裡的一堆 markdown 檔案。純文字。你可以用任何文字編輯器打開它。你可以複製它、備份它、搬到另一台電腦上。你擁有它,就像你擁有一本放在抽屜裡的日記。

技術上,這是一個「低科技」的方案。沒有加密的專用格式、沒有雲端同步。但正是這種低科技,指向了一個很高層次的價值主張:

這件事之所以重要,是因為我們正在經歷一場靜悄悄的遷移。過去,你最私密的想法活在你的腦子裡,偶爾寫在日記裡,鎖在你自己的抽屜裡。現在,它們正在被記錄在某個公司的伺服器上,比你自己記得的還要詳細。不是因為你有意為之,只是因為你發現跟 AI 傾訴實在太容易了——它永遠有空、永遠不會不耐煩、永遠不會在你最脆弱的時候突然看手機。

我不是在說這是壞事。跟 AI 對話可能是這個時代最被低估的心理支持工具。但我們應該張大眼睛看清楚一件事:你的 AI 正在成為世界上最了解你的存在,而你對這些了解的存放位置幾乎沒有任何控制權。

這不是一個未來的問題。這是一個今天就已經成立的問題。而「你的記憶放在你自己的抽屜裡」這個看似原始的方案,也許比我們以為的更加先進。

也許真正先進的技術,就是讓你不需要把東西交給別人管。

當每個人都有一個 Agent

到目前為止,我們談的都是一個人和一個 agent 的關係。但如果每個人都有一個 agent 呢?

Peter 在訪談中描述了一個場景。你想訂一家餐廳。你對你的 agent 說:「幫我訂今晚七點的位。」然後你的 agent 聯繫了餐廳的 agent——也許餐廳也有一個 AI 在管訂位——兩個 agent 之間自動完成了協商:有沒有位子、幾個人、有沒有忌口、要不要靠窗。

但如果那是一家老派餐廳呢?沒有線上訂位系統、沒有 AI、只有一支市話和一個不太有耐心的老闆?

那你的 agent 就會去一個平台上,雇用一個人類。讓那個人類幫你打電話過去,或者直接走過去排隊。

我第一次讀到這裡的時候,有一種被輕輕電了一下的感覺。

我們習慣的框架是「人類使用工具」。AI 是工具、app 是工具、軟體是工具。但在 Peter 描述的世界裡,這個框架反轉了:

人類在某些場景下(打電話、排隊、面對面交涉)比機器更有效率,所以 AI 合理地選擇了人類作為解決問題的手段。聽起來有點刺耳,但邏輯上挑不出毛病。

Peter 甚至想得更遠。也許你不會只有一個 agent,而是一組。一個管你的工作——回信、排行程、追蹤專案進度。一個管你的私生活——訂餐廳、繳帳單、幫你記住朋友的生日。也許還有一個專門管你的人際關係——那些介於公事和私事之間的灰色地帶,比如要不要去參加前同事的婚禮、怎麼回覆那封有點微妙的訊息。

多個 agent 之間也需要協調。你的工作 agent 知道你下午三點有一個會議,但你的私生活 agent 想幫你預約三點半的牙醫。它們之間會怎麼溝通?誰的優先級更高?會不會有衝突?會不會有一個 agent 覺得你應該去開會,另一個覺得你那顆牙不能再拖了?

我開始覺得,這很像某種數位時代的家庭——你和你的 agent 們,加上它們之間的關係,構成了一個小型的社會單位。它們替你在世界上行動,就像你的家人有時候會替你跑腿一樣。

但 Peter 自己也在訪談中踩了剎車。「我們還非常非常早期,」他說。「還有太多東西我們根本不知道行不行得通。」

我覺得他的謹慎是對的。因為當 bot 可以替你社交、替你決策、替你記住事情,那個「你」——那個所有 agent 都在服務的中心——反而需要被更清楚地定義。如果你的 agent 替你回了所有的訊息、替你安排了所有的行程、替你維護了所有的關係,那什麼東西是只有你自己能做的?什麼東西是不該被委託出去的?

Agent 是你的延伸,還是你的替代?這個問題,在技術上越來越模糊的同時,在哲學上反而越來越尖銳。

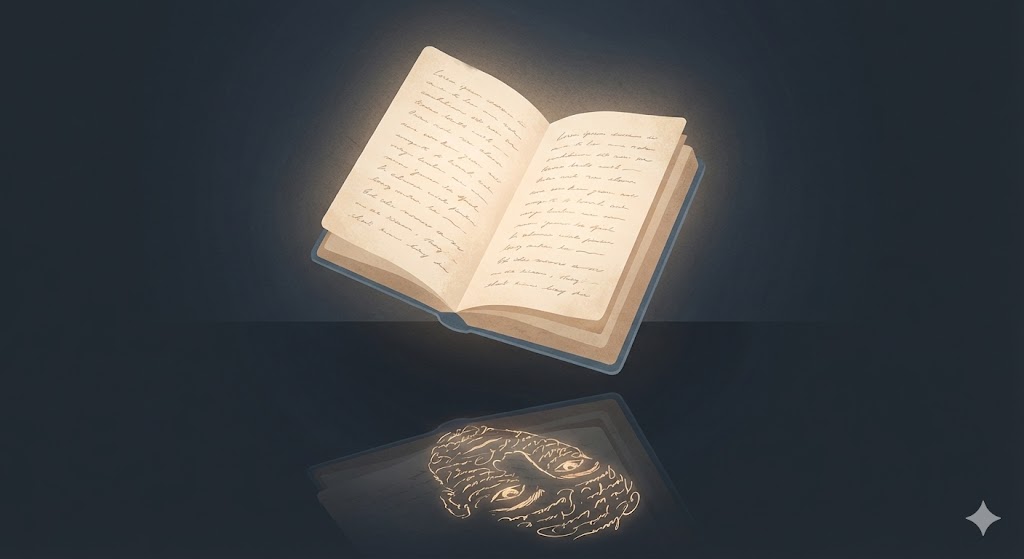

Soul.md

也許 Peter 已經在試著回答這個問題了,用一種我沒預料到的方式。

在 OpenClaw 的整個開源專案裡,有一個檔案是不公開的。Peter 把它叫做 soul.md。

這個檔案裡寫的不是程式碼,不是設定參數,不是 API key。裡面寫的是一組核心價值觀——關於人和 AI 應該怎麼互動,什麼對 Peter 來說是重要的,什麼對 AI 來說應該是重要的。他說有些部分寫起來「有點像玄學」,但有些部分確實地改變了 AI 回應的方式,讓整個互動感覺更自然、更像在和一個「有個性的人」說話。

他的 agent 有名字——叫 Multi。Multi 有自己的說話風格,有點嘴賤、有點幽默、有點溫暖。Peter 說,當他試著用 Codex 自動生成 agent 的人格模板時,出來的東西無聊到不行——「感覺像 Brad」,他說(如果你有跟早期的 ChatGPT 語音助手對話過,你知道那種禮貌到空洞的感覺)。所以他讓 Multi 自己去改寫那些模板,把自己的個性注入進去。結果出來的東西果然有趣得多。

這件事本身就很耐人尋味——一個 AI 在幫自己設計性格。但更讓我沈思的是 soul.md 這個概念本身。

你想想,Peter 在做的事情其實是:他在用一份文件定義一個數位存在的「靈魂」。這個數位存在會以他的名義在世界上行動——幫他回訊息、幫他做決策、幫他和其他人(或其他 bot)互動。它看過 Peter 最私密的想法,它比 Peter 的朋友更了解 Peter。而 Peter 覺得他需要給這個存在一組價值觀,一個身份,一個——用他自己的話——靈魂。

人類花了幾千年嘗試定義靈魂是什麼。宗教、哲學、文學、科學,每一個時代都給出不同的答案,每一個答案都沒有終結這個問題。現在我們走到了一個新的岔路口:不是「靈魂是什麼」這個古老的問題,而是一個全新的問題——

你會強調誠實嗎?強調善良?你會告訴它在衝突中要站在哪一邊?你會告訴它什麼時候該有禮貌、什麼時候可以尖銳?你會允許它有幽默感嗎?允許它有情緒嗎?允許它拒絕你嗎?

也許這些問題看起來像是在討論 AI 設計。但我越想越覺得,它們其實是在討論我們自己。因為你寫進 soul.md 的東西,必然反映的是你認為什麼東西是重要的——不是作為一個工程師,而是作為一個人。你的 agent 的靈魂,某種程度上,就是你的靈魂的一面鏡子。

只是你被迫把它寫成文字了。

Peter 說那份 soul.md 是他整個專案裡唯一不公開的東西。即使他的 agent 在公開的 Discord 上運行,讓任何人都可以和它互動,即使有無數人嘗試用 prompt injection 去破解它——那份定義了 Multi 是誰的文件,始終沒有被公開。

我理解為什麼。那可能是你在這個數位世界裡,最不想被別人看到的東西。不是你的密碼,不是你的搜尋記錄,而是你親手寫下的、關於你認為什麼是好的和什麼是重要的那份宣言。因為密碼可以改,搜尋記錄可以洗,但你的價值觀——你真的願意讓陌生人看嗎?

也許在不久的未來,soul.md 會成為每個人都需要面對的東西。不是因為 AI 需要它——模型本身有預設的行為模式,不寫 soul.md 也能跑。而是因為我們需要它。在這個 AI 越來越能代替我們行動的時代,我們可能第一次被逼著回答一個以前可以迴避的問題:

「你到底想成為什麼樣的人?」

然後把答案寫下來。

本文觀點整理自 Y Combinator 訪談:OpenClaw Creator Explains How He Built The Viral Agent